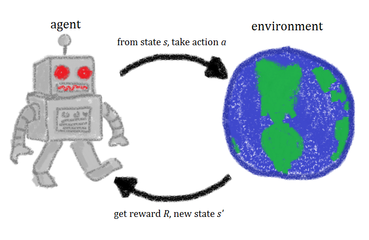

Učenie s posilňovaním (reinforcement learning, RL) je oblasť strojového učenia, ktorá študuje, ako sa má agent správať v prostredí tak, aby maximalizoval kumulatívnu odmenu. Inšpiráciu čerpá z experimentov v biológii učenia a z princípov behavioristickej psychológie. RL sa odlišuje od iných paradigmát strojového učenia, napríklad od učenia pod dohľadom, tým, že tréningový signál nie je párom vstup–správny výstup, ale hodnotenie následkov akcií.

Základné zložky

- Agent: rozhodovacia entita, ktorá na základe pozorovaní vykonáva akcie (agent).

- Prostredie: externer kontext vracajúci stavy a odmeny.

- Politika (policy): pravidlo alebo funkcia mapujúca stavy na akcie; môže byť deterministická alebo stochastická.

- Funkcia hodnoty: odhaduje očakávanú budúcu odmenu stavu alebo páru (stav, akcia).

- Odmena: signál, ktorý agent optimalizuje (odmena); jej návrh je kľúčový a často náročný.

- Model prostredia: odhad prechodovej dynamiky; podľa jeho prítomnosti sa hovorí o model-based alebo model-free prístupoch.

Formálny rámec a teória

Štandardným formálnym modelom pre RL sú Markovove rozhodovacie procesy (MDP), ktoré zahŕňajú množinu stavov, akcií, funkciu prechodov a funkciu odmeny. Cieľom je nájsť politiku maximalizujúcu očakávanú kumulatívnu zľavnenú odmenu v čase. Teoretické metódy zahŕňajú dynamické programovanie, Monte Carlo metódy a temporal-difference (TD) učenie, ktoré poskytujú základy pre praktické algoritmy.

Hlavné typy algoritmov

- Value-based metódy: učia sa hodnotu stavov alebo stav–akcia párov; príkladom je Q-learning.

- Policy-based metódy: priamo optimalizujú politiku pomocou gradientov politík (policy gradients).

- Actor–critic: hybridné prístupy kombinujúce politika (actor) a odhad hodnoty (critic).

- Model-based metódy: stavajú alebo využívajú model prostredia na plánovanie a predpoveď.

Praktické aspekty a metódy

V praxi sa často používajú heuristiky pre prieskum (exploration) a využívanie (exploitation), napríklad epsilon-greedy alebo softmax výber. Pri vysokodimenzionálnych vstupoch (obrazy, senzory) sa RL kombinuje s hlbokými neurónovými sieťami — tzv. deep RL — aby sa automaticky učili reprezentácie. Medzi bežné problémy patrí nízka sample-efficiency, citlivosť na návrh odmeňovacieho signálu, problémy s nestabilitou tréningu a slabá generalizácia do nových situácií.

Výzvy, bezpečnosť a etika

Pri nasadzovaní RL v reálnych aplikáciách je dôležité zvážiť bezpečnosť správania, riziká nečakaných výsledkov a etické dôsledky učenia z interakcií s používateľmi. Návrh odmien môže viesť k nežiadaným cieľom (reward hacking) a preto sa často používajú obmedzenia, zásady robustného učenia a testovanie v simuláciách pred reálnym nasadením.

Aplikácie

- Hry: učenie hierných stratégií a tréning agentov v simulovaných prostrediach.

- Robotika: učenie pohybu, manipulácie, plánovania akcií a adaptácie na zmeny.

- Priemysel: optimalizácia procesov, plánovanie údržby, správa energie a riadenie výroby.

- Personalizácia: odporúčacie systémy a adaptívne rozhrania, ktoré sa učia z interakcií používateľov.

- Doprava a autonómne systémy: plánovanie trás a rozhodovanie v reálnom čase.

Porovnanie s inými paradigam

Na rozdiel od učenia pod dohľadom, kde sú k dispozícii označené príklady správnych výstupov, RL získava len spätnú väzbu v podobe odmien. V porovnaní so širším strojovým učením je RL špecificky zamerané na problém rozhodovania v čase. Jeho psychologické a biologické korelácie možno skúmať cez štúdie biológie a operantného podmieňovania, a rola odmien je detailnejšie rozobraná v literatúre o odmenách.

Pre študentov a praktikov je vhodné začať s teóriou MDP a jednoduchými algoritmami typu Q-learning či policy gradients a následne prejsť k hlbokej integrácii a simulovanému testovaniu. Pre technický prehľad o agentoch a princípoch strojového učenia pozrite tiež zdroje o agente a strojovom učení. Pre širší psychologický kontext navrhujeme referencie k behavioristickej psychológii a k klasickým dielam o operantnom podmieňovaní.